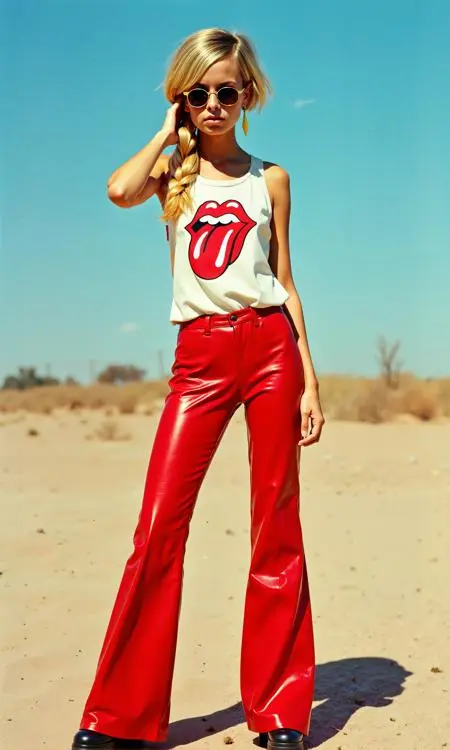

Twiggy [2.3MB 单变压器Flux LoRa]

0

0

0

0

PhotographyRealisticGirl

v1.0

Cập nhật gần đây: Đăng tải lần đầu:

The LoRa was trained on just two single transformer blocks with a rank of 32, which allows for such a small file size to be achieved without any loss of quality.

Since the LoRa is applied to only two blocks, it is less prone to bleeding effects. Many thanks to 42Lux for their support.

Thảo luận

Phổ biến nhất

|

Mới nhất

Gửi

Đến sớm

Tải xuống

(0.00KB)

Chi tiết

Loại

Số lần tạo hình ảnh trực tuyến

0

Tải xuống

0

Tham Số Đề XuấtAdd

Bộ sưu tập hình ảnh

Phổ biến nhất

|

Mới nhất